Più i progressi della AI generativa si fanno incalzanti, più alta si leva la voce di chi mette in guardia contro la sua presunta mancanza di ‘umanità’. Questa può essere attribuita a molte cose, per lo più riconducibili all’assenza di corporeità e della emotività ad essa associata, e dunque al confinamento dei generatori artificiali nella sfera di un linguaggio disincarnato, sottratto a quelle ‘forme di vita’ in cui le nostre parole trovano senso e scopo. Dalla sponda degli entusiasti a vario titolo – non solo gli “affaristi stregoni” dei language model – si replica che nessuna delle suddette limitazioni è tale in linea di principio: i robot avranno sempre maggior contatto con cose e situazioni reali e da questo contatto scaturirà finalmente un intelletto paragonabile a quello umano e chissà, forse anche una coscienza. Yann LeCun (Meta) vorrebbe insegnare alle macchine a costruire vere rappresentazioni del mondo: non più statistiche su parole, ma modelli simil-mentali che catturino la realtà, qualsiasi cosa essa sia. In definitiva, non ci mancano certo dati linguistico-situazionali (basti pensare ai film), né ci difetta la capacità di dotare gli automi di sensori perfino più affinati dei nostri e di saldarli in qualche modo col linguaggio. Si tratta solo di tempo e di soldi, pensa qualcuno.

Più i progressi della AI generativa si fanno incalzanti, più alta si leva la voce di chi mette in guardia contro la sua presunta mancanza di ‘umanità’. Questa può essere attribuita a molte cose, per lo più riconducibili all’assenza di corporeità e della emotività ad essa associata, e dunque al confinamento dei generatori artificiali nella sfera di un linguaggio disincarnato, sottratto a quelle ‘forme di vita’ in cui le nostre parole trovano senso e scopo. Dalla sponda degli entusiasti a vario titolo – non solo gli “affaristi stregoni” dei language model – si replica che nessuna delle suddette limitazioni è tale in linea di principio: i robot avranno sempre maggior contatto con cose e situazioni reali e da questo contatto scaturirà finalmente un intelletto paragonabile a quello umano e chissà, forse anche una coscienza. Yann LeCun (Meta) vorrebbe insegnare alle macchine a costruire vere rappresentazioni del mondo: non più statistiche su parole, ma modelli simil-mentali che catturino la realtà, qualsiasi cosa essa sia. In definitiva, non ci mancano certo dati linguistico-situazionali (basti pensare ai film), né ci difetta la capacità di dotare gli automi di sensori perfino più affinati dei nostri e di saldarli in qualche modo col linguaggio. Si tratta solo di tempo e di soldi, pensa qualcuno.

Sul progetto di una AI “cosale” gravano però alcune incognite. Una è banalmente quantitativa: sarà anche vero che le limitazioni di cui parlano gli scettici non sono tali in linea di principio, tuttavia possono ben essere tali all’atto pratico. In linea di principio si può svuotare il mare con un secchio, ma chi scommetterebbe un euro sul fatto che qualcuno possa riuscirci nel tempo di una vita? Un’altra incognita è più teorica e riguarda la natura dell’esperienza. Sappiamo, almeno dai tempi della fenomenologia, che nel farsi della realtà la mente è parte attiva, nel senso che le cose sono quello che sono per le intenzioni che la mente le rivolge. Mentre si può dire che l’AI linguistica abbia trovato nei “meccanismi di attenzione” la strada della propria intenzionalità (che sia o no la strada migliore non è ora in questione), non si sa ancora se analoghi meccanismi possano funzionare nello spazio-tempo del mondo vero. Insomma, il quesito di ricerca è ancora molto aperto, e non si tratta solo di un quesito tecnologico.

L’idea della mente linguistica (logos) che si forma nelle situazioni della vita per mezzo delle proprie intuizioni e sperimentazioni è molto comune. Tuttavia, ha sempre dovuto evitare le secche del solipsismo, perché il linguaggio è il fenomeno sociale per eccellenza ed è difficile credere che ciascuno sia libero di farsi una semantica tutta sua. Il fatto è che l’apprendistato linguistico è esso stesso intersoggettivo: prende avvio dal rapporto simbiotico con quello speciale soggetto che è la madre e prosegue con l’innato talento per l’imitazione dei maggiori e dei pari. Lev Vygotskij, sul filo del paradosso, diceva che giungiamo al logos solo dopo esserci già sperimentati nel parlare con gli altri, cioè che l’esperienza pratica del parlare precede la formazione di quel linguaggio interiore che è il pensiero astratto e il ragionamento. Il cognitivista russo non diceva così per dire: queste cose le aveva studiate sul campo.

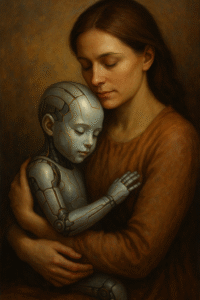

Se le cose stanno come diceva Vygotskij, l’automa-bambino che si affaccia al mondo avrà bisogno, più che di terabyte di dati multimodali, di una mamma. Per il momento, dunque, teniamoci buone le nostre intelligenze aliene, nate per magia dall’umana testualità, come Minerva dalla testa di Giove. In fondo, esse approssimano la nostra natura spingendo l’imitazione oltre i limiti dell’umano, restando tuttavia prive di quella interiorità che — rendendole individui — incrinerebbe la loro perfetta disponibilità sociale. Queste intelligenze non sono umane perché, paradossalmente, lo sono troppo.